-

琉球大学 工学部 情報工学専攻 准教授

姜 東植

- その他

- 情報通信

映像分析による学習支援ツールの開発

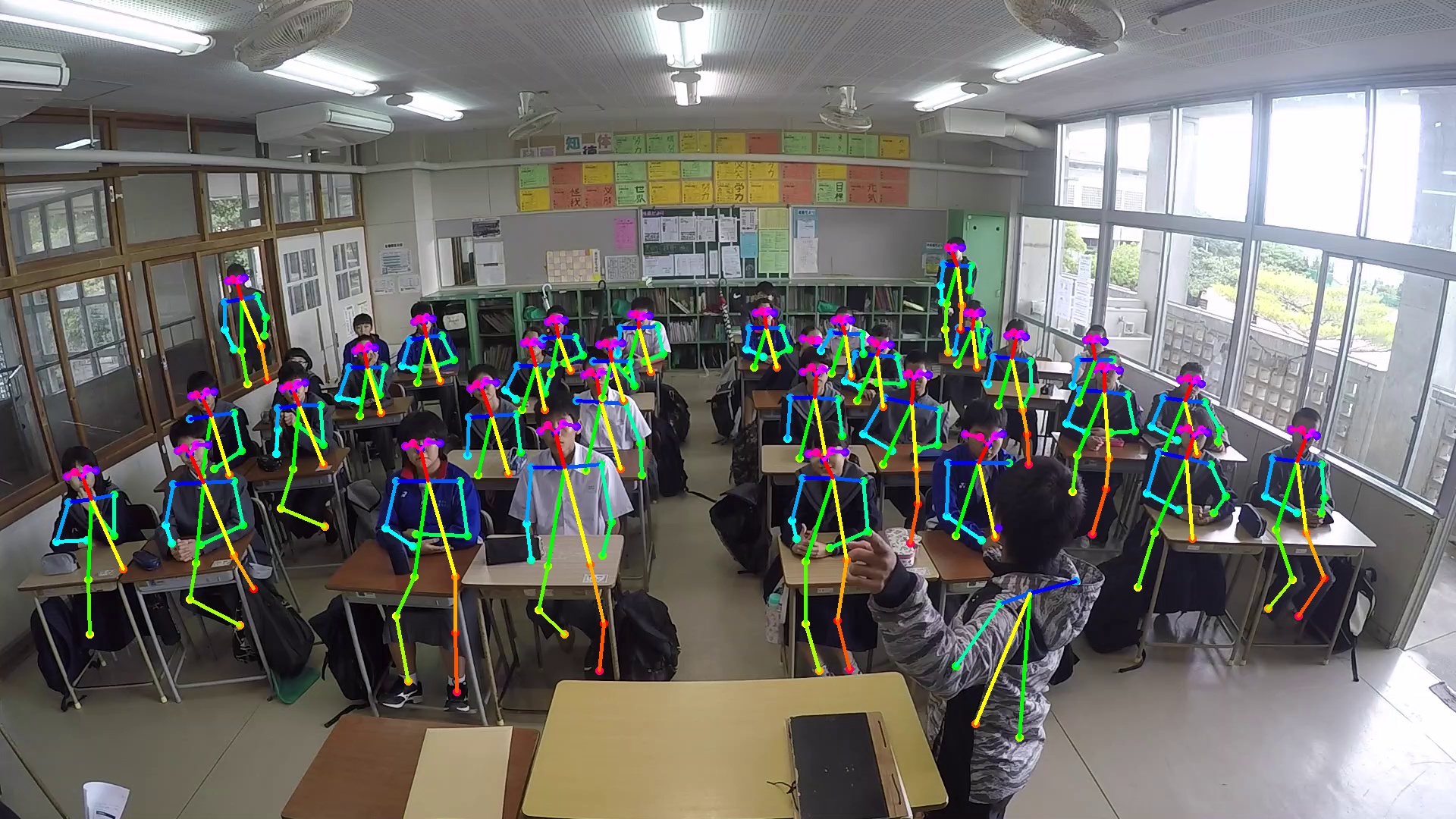

本システムは授業中の教室全体を定点撮影した動画から,各個人の集中度を推定をするものである.

そして、システムの構成は大きく分けて ①映像入出力部,②動作検出 部,③集中度推定部の3つのパーツで成り立っている.

授業中の様子を撮影した動画を入力し,内部で処理が行われた後,集中度が出力されること を最終的な目標としている.入力される映像は,1 定点から教室全体を撮影したものである.また,授業形式は聴講者全員が着席した座学を対象としている.

▼2-1 映像入出力部

入力された映像は,OpenPose により目や鼻,手など 18 点のキーポイントの座標が 検出される.今回の実験ではカメラは正面方向から1カ所に設置した.カメラは GoPRO を用い,解像度 1080p,fps60 で撮影を行った.

▼2-2 動作検出部

まず,人物を検出するため,OpenPose により得られる 18の座標データを用い,人物を検出する.具体的には,首の座標を利用し,ある大きさの人物領域を設定する.したがって,人数分の領域が生成され,人物の中心として判断する.このように,検出した人物領域を,教室の前列から割り当てていく作業を行う.

次に,顔の動きの推定するため,両目,両肩,首,両手首の座標値から「顔の動き」と「髪や顔を触る,ほお杖をつく仕草」,「顔の向きの変化」の 3つの動作を推定する.

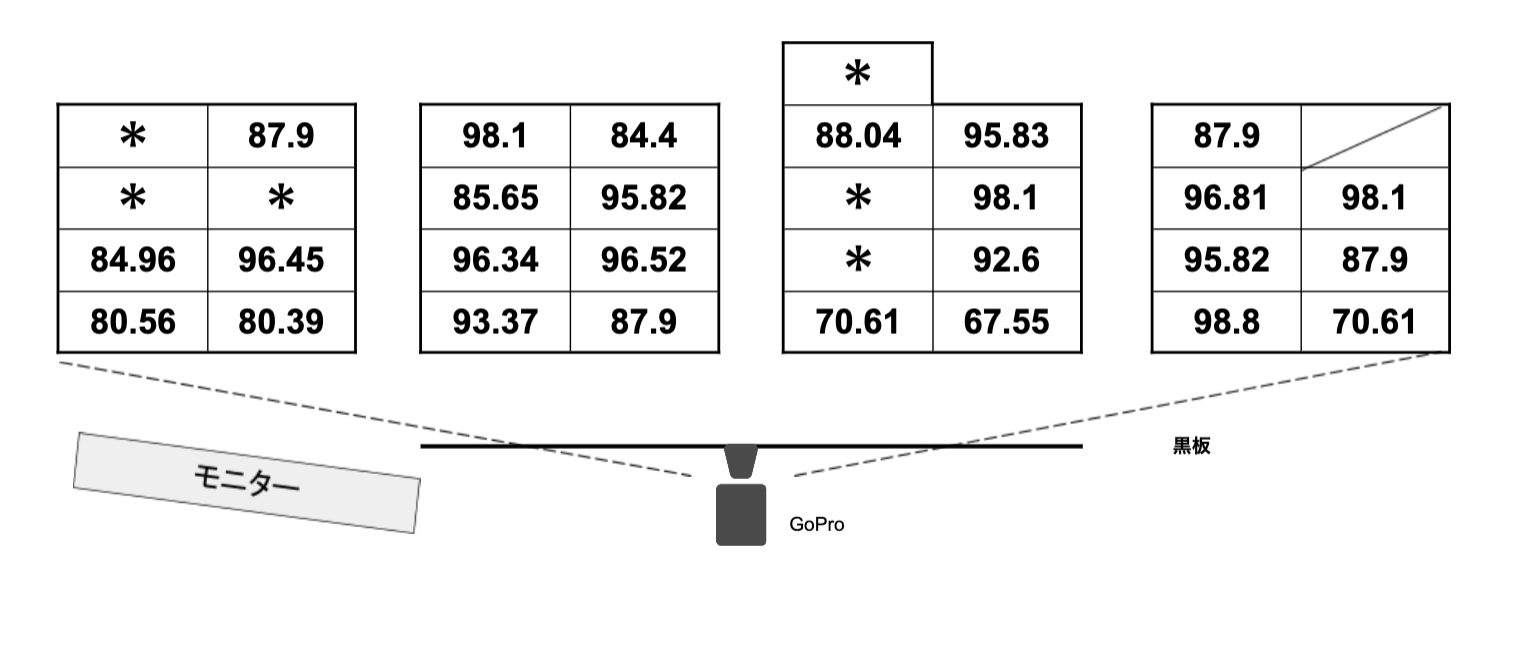

▼2-3 集中度算出部

本パーツでは,2 種類の動作を元に聴講者の動作譜を作成し,その変化を計測することで集中度を算出する.今回想定されている環境は教室で行われる座学であり,聴講者は全員着席状態でその場から動き回ることはない,動作が発生した場合には,聴講者自身が姿勢を変える,よそ見をするといった大きな姿勢の変化があることが予想される.しかし,講義内では挙手や手元の用紙に記入を行うこともあり,動いていることが正解となるフレームも存在する.そのため,聴講者の過半数以上が行っている行動を正解であると仮定し,正解値と聴講者個人の行動が一致しているかどうか比較を行い,動作を判断している.

今回は集中度推定部においては,動作のみで集中度を推定するシステムを提案したが,実際動作譜に対し聴講者個人による検証を行い、その結果を反映することで,より高精度の集中度推定が可能となると考える.

図1:人物検出結果

図2:可視化結果